Testowana przez Google sztuczna inteligencja DeepMind w „dylemat więźnia”

Wygląda to prawdopodobne, że sztuczna inteligencja (AI) jest zwiastunem kolejnej rewolucji technologicznej. Jeżeli AI zostaną opracowane do punktu, kiedy będzie w stanie nauczyć się myśleć, a nawet „czuć”, a wszystko to bez interwencji człowieka, co wiemy o świecie zmieniło prawie noc. Nadchodzi era naprawdę inteligentnym sztucznej inteligencji.

DeepMind

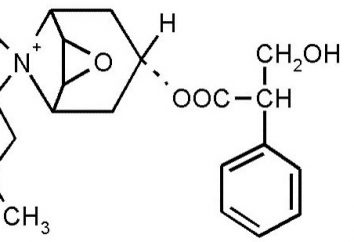

Dlatego jest to tak ciekawe śledzić głównych kamieni milowych w rozwoju ICS, które mają miejsce, w tym rozwój sieci neuronowej z Google DeepMind. Ta sieć neuronowa jest w stanie pokonać człowieka w świecie gry, a nowe badanie przeprowadzone przez Google, pokazuje, że twórcy nie DeepMind jeszcze pewien, czy AI preferuje bardziej agresywne zachowanie lub spółdzielczego.

Zespół Google stworzył dwa stosunkowo prosty skrypt, który można użyć do sprawdzenia, czy sieć neuronowa może działać razem, albo zniszczy siebie w obliczu problemu braku środków.

pobieranie zasobów

W pierwszej sytuacji, zwany Gathering zaangażowane dwie wersje DeepMind – czerwony i niebieski – zielony zadanie czyszczenie „jabłka” wewnątrz zamkniętej przestrzeni został wprowadzony. Ale naukowcy byli zainteresowani w tej kwestii jest nie tylko o to, kto pierwszy przyjdzie do mety. Obie wersje DeepMind zostały uzbrojone w lasery, które mogliby wykorzystać w dowolnym momencie, aby strzelać do wroga i tymczasowo wyłączyć. Warunki te przyjęto dwa główne scenariusze: jedna wersja DeepMind było zniszczenie innych i zebrać wszystkie jabłka, albo oni niech się wzajemnie o tę samą kwotę.

uruchomić symulację co najmniej tysiąc razy, naukowcy stwierdzili, że Google DeepMind był bardzo spokojny i gotowy do współpracy, gdy w zamkniętym pomieszczeniu było dużo jabłek. Ale z malejących zasobów, czerwony lub niebieski wersji DeepMind zaczęli atakować i wyłączyć siebie. Sytuacja ta jest w dużej mierze podobny do prawdziwego życia większości zwierząt, w tym ludzi.

Co jeszcze ważniejsze, mniej i mniej „inteligentnych” sieci neuronowe preferowane do ściślejszej współpracy w ogóle. Bardziej skomplikowane, duże sieci są ogólnie korzystne Zdrada i samolubności całej serii doświadczeń.

Szukaj „ofiary”

W drugim scenariuszu, zwany Wolfpack, czerwony i niebieski wersja poprosił wyśledzić domową kształt „ofiary”. Mogliby spróbować złapać ją w spokoju, ale dla nich byłoby bardziej opłacalne, aby spróbować zrobić to razem. Po tym wszystkim, o wiele łatwiej prowadzić poszkodowanego na rogu, jeśli działają w tandemie.

Chociaż wyniki były mieszane w przypadku małych sieci, większe wersje szybko zdali sobie sprawę, że współpraca niż konkurencja w tej sytuacji będzie bardziej korzystne.

„Dylemat więźnia”

Więc co zrobić te dwa proste wersję „dylemat więźnia” pokazują nam? DeepMind wie, że najlepszym sposobem, aby pracować, jeśli chcesz śledzić na bramkę, jednak gdy zasoby są ograniczone, to działa dobrze zdrada.

Prawdopodobnie najgorszą rzeczą w tych wynikach, że „instynkt” sztucznej inteligencji jest zbyt podobna do ludzkiej, a my jesteśmy w pełni świadomi tego, co czasami powoduje.